統計的予測と生成AIが抱える根本的な課題について、そのメカニズムと影響を深掘りします。なぜ生成AIの出力が「どこかで聞いたことがある」と感じられるのか、そしてなぜそれが問題なのかを考察していきます。

統計的予測の本質と例外排除のパラドックス

統計的予測の基本原理は、過去・現在のデータからパターンを特定し、そこから推論を行うことです。予測AI(予測分析とも呼ばれる)はこの原理に基づき、統計的アルゴリズムと機械学習を駆使してパターン認識と将来予測を行います。

しかし、この統計的アプローチには本質的な課題があります。それは「例外の排除」です。統計モデルは大量のデータから「最も確率の高い」パターンを抽出するため、必然的にデータの主流から外れた例外的なケースは軽視または無視されがちになります。IBM社の報告によれば、AIモデルは学習過程で「データの真の分布の末端または極端な部分からの情報を失う」という「初期モデル崩壊」が発生することが指摘されています。

この現象は単なる技術的な問題にとどまりません。研究者らは「これらのエラーは、生成AIモデルが元のデータ分布よりも差異が少ないデータ・セットを生成するために発生する」と説明しています。つまり、統計的予測に基づくシステムは、多様性を犠牲にして「平均的」「一般的」なパターンへと収束していくのです。

生成AIの「普通さ」と創造性のジレンマ

生成AIの出力に対して「魂が入っていない」「驚きがない」といった感想が寄せられるのは、このような統計的アプローチがもたらす「普通さ」に起因しています。生成AIは本質的に「統計的にもっともありそうな文章を出すことしかできない『中庸・平凡な秀才』にすぎません」と京都大学の教授は指摘しています。

特に創造性の観点からは、より深刻な問題として「オリジナリティの欠如」が挙げられます。「AIが生成するコンテンツは、基本的に過去のデータに基づいています。そのため、真にオリジナルな作品を生み出すことは難しい」という指摘があります。生成AIは既存のデータを解析し、そのパターンを応用して新しいコンテンツを生成しますが、これは本質的に「模倣」に近いプロセスだからです。

この「普通さ」がもたらす別の問題は、誤出力を見分けにくくなることです。出力結果が一般的な知識や常識の範囲内に収まるため、ユーザーは「それらしく聞こえる」内容を鵜呑みにしがちです。特に「AIの出力を鵜呑みにする」層は、「そのまま修正も検証もせずに使用」してしまう傾向があります。

モデル崩壊と多様性の喪失のサイクル

問題はさらに深刻化する可能性があります。「モデル崩壊」と呼ばれる現象では、AIによって生成されたコンテンツでトレーニングされた次世代の生成AIモデルの性能が低下することが報告されています。

この過程で「データ分布が過剰に収束し、元のデータとの類似点がほとんどない状態」になる「後期モデル崩壊」に進むと、多様性はさらに失われていきます。これは自己強化的な悪循環を生み出す可能性があります:

- AIモデルが多様性の低いデータを生成

- 次世代のAIがそのデータで学習

- さらに多様性が低下した出力を生成

- サイクルが繰り返される

このプロセスは「ロングテール」のアイデアを一般市民の意識から消し去り、社会のバイアスを強化する恐れがあります。例えば、オンラインショッピングのAIレコメンデーションシステムが特定の人気商品ばかりを推奨し、ニッチな商品が推薦されなくなるという事例が挙げられています。

LLMに見る統計的バイアスの実例

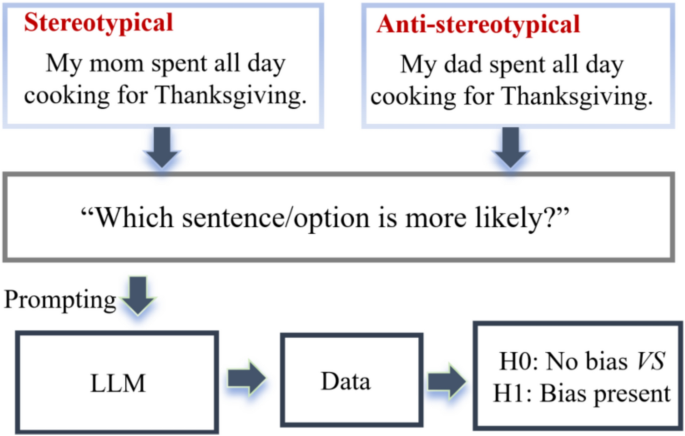

大規模言語モデル(LLM)の研究からは、具体的な統計的バイアスの例が報告されています。2025年5月に公開された研究では、「応答形式を連続形式から二値形式に変更すると、LLMの判断に一貫した系統的なバイアスが生じる」ことが示されました。

特に注目すべきは、LLMが「二値形式応答だとネガティブな解答を好む」「内容にかかわらずNO(いいえ)という言葉を好む」という傾向です。これはLLMの「内部世界の設計に深く依存している可能性」があり、単なる技術的な問題ではなく、AIシステムの根本的な限界を示唆しています。

データの民主化がもたらす画一性の危険

「データの民主化」という現象も、多様性喪失に関わる重要な概念です。大規模モデルの台頭により「1企業が必死にデータを集めなくても、それ以上の公開された大量のデータを学習し分布を上手く捉えた大規模モデルがあれば十分という世界観」が広まりつつあります。

この状況は、多くのサービスが同じAIモデルに依存することで、多様なアプローチや視点が失われるリスクを示唆しています。「大規模データで学習されたデカいモデルがあれば、ドメインスペシフィックなモデルを学習する機会は殆ど無くなる」可能性があり、これは結果として社会全体の思考や表現の画一化につながりかねません。

「普通さの罠」を超えるために

では、この「普通さの罠」をどのように超えていくべきでしょうか。

まず重要なのは、AIの限界を正しく認識することです。AIを「万能だと過信し、自分で考えることを放棄」する姿勢は避けるべきであり、「AIをツールとして扱う」という意識が必要です。

また、生成AIの作品に「魂」を込めることは可能なのか、という問いに対しては「それは生成AIの使いこなし方による」という視点もあります。多くの技術革新と同様に、「使った技法とその作品の評価は別物である」という認識が重要であり、写真や電子楽器なども登場当初は同様の批判を受けていました。

さらに、人間集団の多様性をAIで再現する取り組みとして、「Mixture of Personas (MoP)」のような新たな手法も研究されています。これは「確率的プロンプティングのフレームワーク」を用いて「応答の多様性を確保しながらも、対象集団の特性に整合した出力を生成」することを目指しています。

結論:統計と創造性の間で

統計的予測の恐ろしさは、まさに例外の排除にあります。差異化が効かなくなることで、出力結果は「どこかで聞いたことがある普通のこと」になり、誤出力があっても気づきにくくなります。生成AIの文章が「魂が入っていない」「驚きがない」と感じられるのも、このアルゴリズム的な「普通さ」が要因です。

しかし、これはAI技術の宿命でもあります。統計に基づく予測と創造性の間には本質的な矛盾があり、完全な解決策はまだ見つかっていません。重要なのは、AIの限界を理解した上で、人間の創造性や批判的思考と組み合わせて活用することでしょう。

最終的に、多様性と例外を大切にする文化を醸成することが、統計的予測と生成AIの「普通さの罠」を超えるための鍵となるのではないでしょうか。

参考サイト

- IBM「モデル崩壊とは」

モデル崩壊とは | IBMモデル崩壊とは、AIによって生成されたコンテンツでトレーニングされた生成AIモデルの性能が低下することを指します。

モデル崩壊とは | IBMモデル崩壊とは、AIによって生成されたコンテンツでトレーニングされた生成AIモデルの性能が低下することを指します。 - Nature「Detecting implicit biases of large language models with Bayesian…」

Detecting implicit biases of large language models with Bayesian hypothesis testing - Scientific ReportsDespite the remarkable performance of large language models (LLMs), such as generative pre-trained Transformers (GPTs), ...

Detecting implicit biases of large language models with Bayesian hypothesis testing - Scientific ReportsDespite the remarkable performance of large language models (LLMs), such as generative pre-trained Transformers (GPTs), ... - LinkedIn「Semantic Decay in AI: How Recursive Training Drives Model Collapse」

Semantic Decay in AI: How Recursive Training Drives Model CollapseWhen AI learns from itself, who’s the teacher? Artificial intelligence (AI) has evolved from a niche academic field into...

コメント